刷榜风波惊动OpenAI后,百度伐谋(Famou)拿回Agent硬核榜单第一

刷榜风波惊动OpenAI后,百度伐谋(Famou)拿回Agent硬核榜单第一近日,在由 OpenAI 主导设立的权威基准测试 MLE-Bench 上,企业级算法自主优化智能体百度伐谋(Famou)击败了各路玩家登顶,并刷新了 SOTA 成绩。

搜索

搜索

近日,在由 OpenAI 主导设立的权威基准测试 MLE-Bench 上,企业级算法自主优化智能体百度伐谋(Famou)击败了各路玩家登顶,并刷新了 SOTA 成绩。

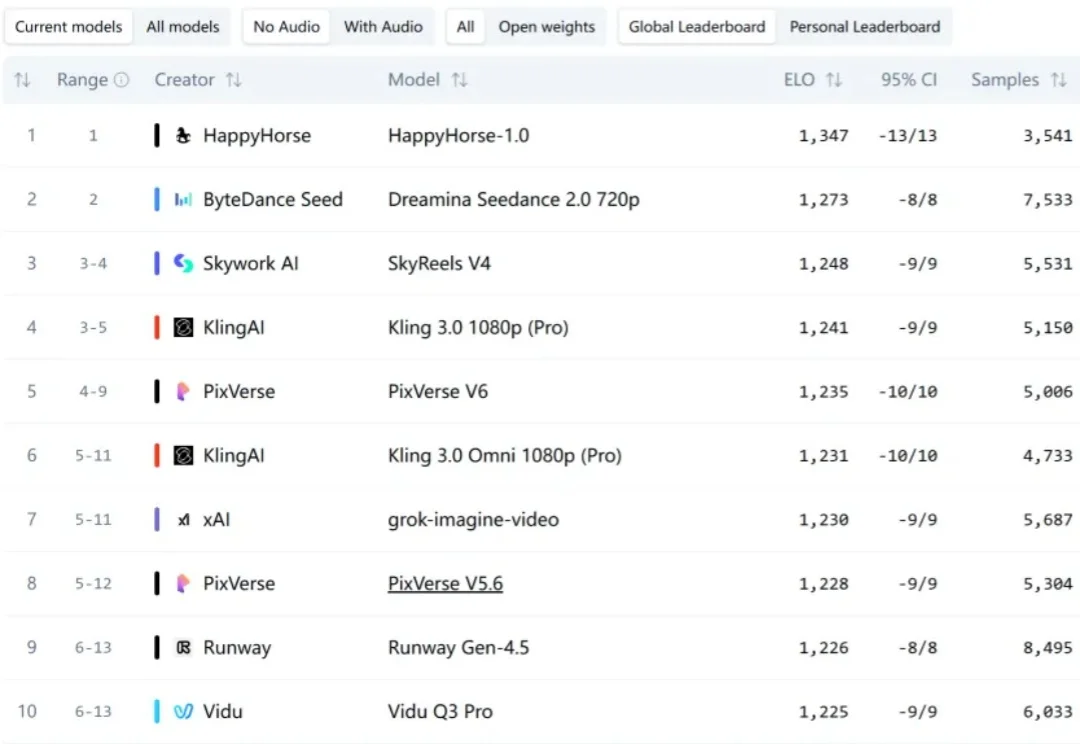

就在 OpenAI 都停了 Sora,所有人以为 Seedance 2.0 要一统天下的时候,没想到不知哪里冒出来一匹马。

近日,OpenAI Codex 产品负责人Alexander Embiricos和OpenAI 的开发者体验(Developer Experience)负责人Romain Huet 一起做客播客,聊了不少 Codex 背后的故事。

一家估值 8520 亿美元的公司,突然开始讲财富再分配,这件事本身比它提的任何政策都更值得玩味。

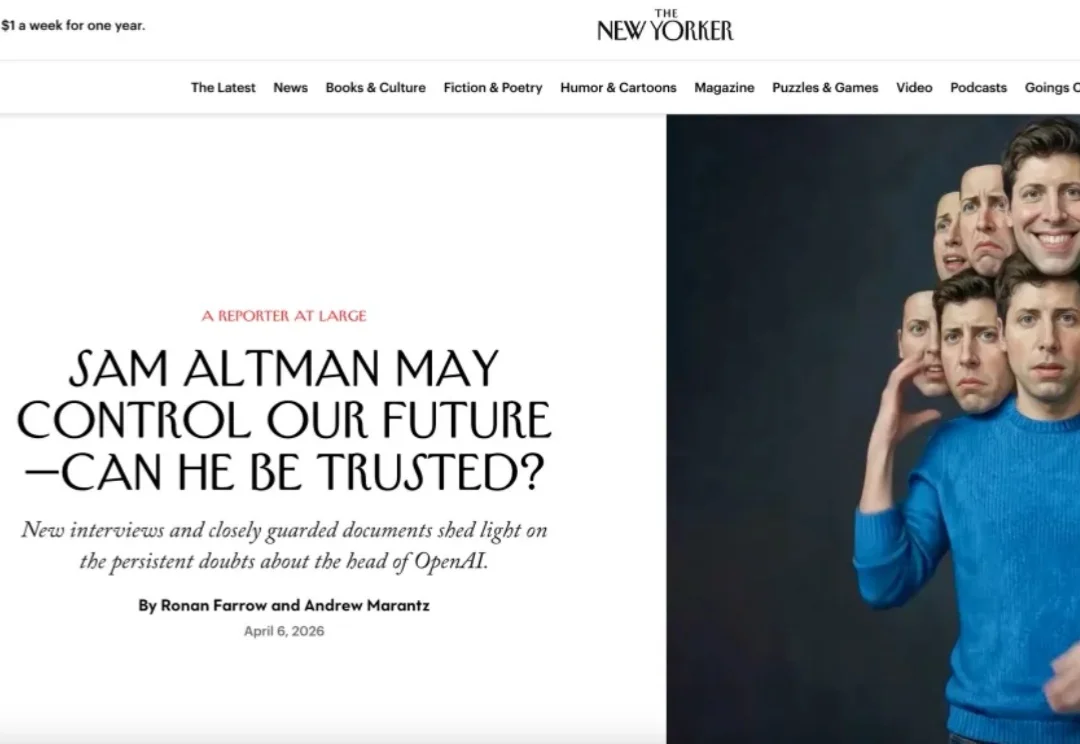

今天《纽约客》发表了历时 18 个月的调查报道,首次披露 OpenAI 首席科学家 Ilya Sutskever 在 2023 年秋天汇编的 70 页内部备忘录,以及 Anthropic 联合创始人 Dario Amodei 保留多年的 200 余页私人笔记。

OpenAI 加快了迈向下一 AI 阶段的进程。

OpenAI Codex 团队的产品规格文档只有 10 个要点。不是说每个功能的文档只有 10 个要点,而是整个产品的 spec 就这么多。设计师写的代码量超过了六个月前工程师写的。50 到 100 人的团队,直到最近才有了第二个产品经理。

2026 年 4 月 2 日,科技播客 Mostly Human 主持人 Laurie Segall 发布了一期重磅对话——与 OpenAI CEO Sam Altman 的深度对谈。这是 Altman 自今年 2 月五角大楼协议风波以来的首次公开长访谈,也恰逢 OpenAI 以 8520 亿美元估值完成 1220 亿美元融资、关停 Sora、高管层剧烈变动的多事之秋。

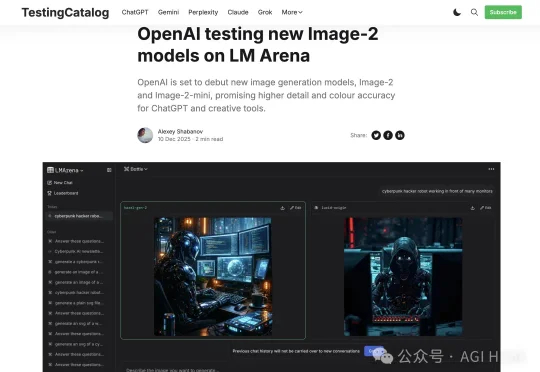

OpenAI 的下一代图像模型 GPT-Image-2,今天在 Chatbot Arena 上被人发现了。独立开发者 levelsio 率先爆料,这个模型以三个代号悄悄上线了 Arena:maskingtape-alpha、gaffertape-alpha、packingtape-alpha。

昨天,OpenAI总裁Greg Brockman在Big Technology Podcast上,亲口透露了他们研究两年的重磅模型成果——Spud大模型。